Nvidia GTC 2026:trazando el rumbo hacia 1 billón de dólares en ingresos por IA

Nvidia GTC (o GPU Technology Conference) se ha convertido en una de las conferencias de inteligencia artificial más importantes del mundo y ha crecido cada año desde su lanzamiento en 2009 junto con la influencia y los ingresos de la empresa. Pero este año marcó un cambio de énfasis. En el pasado, la empresa se centraba en cómo se expandía a nuevos mercados; este año, demostró cómo se expandiría dentro de esos mercados, especialmente como un actor clave en el panorama de la IA. En una clara señal de las ambiciones de Nvidia y su éxito actual, mejoró su proyección de 500 mil millones de dólares en ingresos por IA para 2026 a la asombrosa cifra de 1 billón de dólares para 2027.

En particular, el CEO Jensen Huang abordó las crecientes necesidades en inferencia de IA, así como el rápido crecimiento de las cargas de trabajo de agentes y cómo ese crecimiento podría afectar toda la informática de IA.

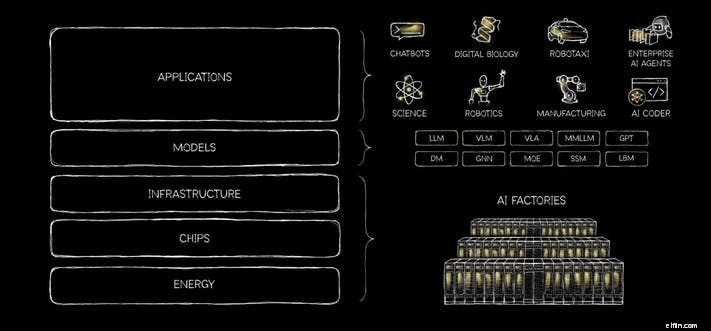

La visión de Nvidia para la pila completa:el pastel de cinco capas de todo

Desde diciembre de 2025, Huang ha estado promoviendo la idea de un “pastel de cinco capas” de IA. Este concepto parece resumir la estrategia general de la empresa para la IA, ya que intenta comunicar la naturaleza intrínsecamente vertical de la tecnología, que es mucho más compleja que una simple aplicación o modelo. La IA se presenta como una infraestructura crítica con múltiples capas que van desde los requisitos energéticos subyacentes hasta las aplicaciones individuales. Esto también intenta simplificar la complejidad de una pila completa de IA para la persona promedio.

El pastel de IA de cinco capas de Nvidia

Foto cortesía de Nvidia

En la base de esta pila se encuentra la energía, que está atrayendo más atención como factor limitante de la cantidad de computación que se puede construir en una ubicación determinada. A su vez, los chips que utilizan esa energía determinan la cantidad de computación disponible para resolver problemas de IA. Luego viene la infraestructura que respalda estos chips con terrenos, edificios, suministro de energía, equipos informáticos, refrigeración y redes. La infraestructura permite modelos de IA, que varían según la aplicación y el caso de uso. En el nivel superior, las propias aplicaciones aprovechan los resultados del modelo para ofrecer resultados a los consumidores, usuarios empresariales, entidades gubernamentales, etc.:la base del valor económico de la IA.

Huang dijo que era necesario reinventar toda la pila informática para respaldar "la mayor construcción de infraestructura en la historia de la humanidad". Nvidia está utilizando este mensaje para posicionarse no solo como un fabricante de chips, sino también como un facilitador fundamental para toda la informática porque ahora toda la informática está avanzando hacia la IA. El CEO habla del enfoque de Nvidia que combina "integración vertical y apertura horizontal", lo que significa que sus modelos están abiertos a cualquiera, pero su enfoque de la informática está integrado verticalmente en cada capa.

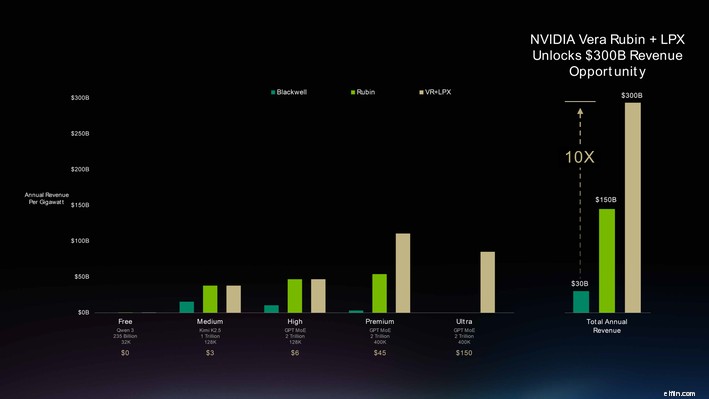

Vera Rubin Pod, LPX y la oportunidad de obtener ingresos multiplicados por 10

Vera Rubin es la próxima plataforma informática de alta gama para Nvidia que combina sus CPU Vera y GPU Rubin; Está previsto que comience a enviarse dentro de unos meses. Vera Rubin Pod es la oferta a escala de rack de Nvidia que promete ofrecer otro aumento significativo en la densidad informática de IA dentro de los centros de datos. Incorpora siete tipos de chips de Nvidia en cinco sistemas de rack diferentes para crear una configuración de alto rendimiento que, según la compañía, permitirá la generación de tokens (e ingresos) a una tasa hasta 10 veces mayor que la plataforma Blackwell de última generación. Nvidia afirma que esto podría permitir una oportunidad de inferencia de hasta 300 mil millones de dólares anuales.

Gráfico que desglosa las oportunidades de inferencia arquitectónica de Nvidia

Foto cortesía de Nvidia

Uno de los mayores factores habilitantes del Vera Rubin Pod es el uso de la plataforma LPX de Groq, aprovechando el chip Groq 3 LM30. La unidad de procesamiento de lenguaje de Groq es intrínsecamente diferente de las GPU de Nvidia, con una cantidad significativa de SRAM (memoria estática de acceso aleatorio) en lugar de DRAM (memoria dinámica de acceso aleatorio). Debido a que aumenta el ancho de banda de la memoria en una asombrosa cifra de 55 veces en comparación con una GPU Rubin, la LPU Groq es intrínsecamente buena para manejar tareas que consumen mucha memoria. Esto ayuda a explicar por qué Nvidia adquirió la propiedad intelectual de Groq y su talento más importante por 20 mil millones de dólares en diciembre de 2025.

Creciendo más allá de las GPU:un enfoque de hardware diversificado

El ejemplo de Groq muestra cómo Nvidia está dejando de intentar que sus GPU sean la solución a todos los problemas. Si bien el ecosistema de Nvidia se ha expandido durante mucho tiempo más allá de las GPU, esa expansión casi siempre ha estado al servicio de la GPU, ya sea mediante CPU, chips de red o software. Con la introducción de las LPU Groq 3, la arquitectura informática de Nvidia realmente ha superado un enfoque exclusivo de GPU.

También estamos viendo que Nvidia comienza a ofrecer productos como sus propias CPU internas basadas en Arm dentro de una solución en rack solo para CPU. La compañía está posicionando la nueva CPU Vera de 88 núcleos como competitiva con Intel y AMD para centros de datos. Estas CPU se pueden configurar con hasta 256 chips por rack y Nvidia ya tiene clientes, incluido Meta, que buscan implementarlas. Más allá de las CPU, Nvidia también habló sobre su solución Bluefield 4 STX para aplicaciones orientadas al almacenamiento; Según la empresa, este producto mejora el rendimiento para evitar que el almacenamiento sea un cuello de botella para la producción de IA.

Más productos de Vera Rubin:Nvidia DSX AI Factory y Space 1

Nvidia DSX es la última plataforma de la compañía basada en Vera Rubin para su oferta AI Factory, que incluye un diseño de referencia para fábricas de AI y aprovecha Omniverse Digital Twin de Nvidia. (Para conocer antecedentes sobre Omniverse, consulte mi artículo sobre GTC 2025 y el análisis detallado de mi colega Bill Curtis sobre los movimientos de Nvidia en la IA física desde febrero de 2025). La compañía llama a esto una solución llave en mano que aprovecha todas las capacidades que Nvidia y sus socios han creado para ayudar a planificar, construir y mantener fábricas de IA. Esta plataforma está diseñada para implementaciones con hiperescaladores y las empresas más grandes que buscan implementar su propia IA a escala industrial sin tener que reconstruir la infraestructura.

Últimamente también ha habido mucho revuelo en torno a la informática de IA en el espacio, y se han lanzado muchas empresas emergentes para resolver los problemas de implementación. Antes del anuncio del módulo Space 1 basado en Vera Rubin, Nvidia implementó principalmente chips Jetson Orin integrados y GPU H100 para aplicaciones espaciales. Nvidia dice que el nuevo módulo centrado en el espacio fue diseñado para estas aplicaciones extremas y ofrece hasta 25 veces más rendimiento de IA en el espacio que el H100. También cuenta con procesamiento sincronizado y códigos de corrección de errores para garantizar que operar en el espacio no afecte la producción. Dicho esto, creo que Space 1 abordará una aplicación bastante específica y no debería considerarse como una validación de la necesidad de centros de datos en el espacio.

NemoClaw:creación de agentes especializados

La IA agente se ha convertido rápidamente en un área importante de atención a medida que agentes como Claude Code ayudan a los usuarios a abordar tareas prácticas. Desde el punto de vista técnico, los agentes están remodelando la forma en que se construye la infraestructura de TI y cómo se diseñan los chips dentro de esa infraestructura. Uno de los desarrollos recientes más interesantes es la introducción de OpenClaw, un agente de código abierto que se ejecuta localmente utilizando la nueva pila NemoClaw de código abierto de Nvidia para implementaciones más seguras de agentes orientados a tareas.

El kit de herramientas del agente NemoClaw está diseñado para crear, entrenar e implementar agentes de IA autónomos y seguros, lo que debería facilitar que cualquiera pueda crear sus propios agentes. En el desarrollo de la nueva pila, Nvidia trabajó estrechamente con el creador de OpenClaw y los investigadores de seguridad para ayudar a prevenir acciones de agente no deseadas o resultados potencialmente peligrosos.

DLSS 5.0:La controvertida implementación del renderizado neuronal

Nvidia sorprendió a muchos, incluyéndome a mí, con el anuncio de DLSS 5.0, que es la función opcional asistida por IA de la compañía para mejorar la calidad de la imagen y ofrecer una renderización más rápida. Funciona renderizando a una resolución más baja y luego usando IA para mejorar la imagen a la resolución nativa. La mayoría de los usuarios parecen estar contentos con las implementaciones anteriores de DLSS. Ahora, DLSS 5.0 introduce técnicas de renderizado neuronal para mejorar aún más la iluminación en escenas que de otro modo podrían parecer planas. También brinda a los desarrolladores de juegos más control sobre la experiencia del usuario y pueden ajustar DLSS 5.0 para cambiar cómo afecta las imágenes de sus juegos.

Mucha gente ha reaccionado negativamente a las primeras fotos y vídeos realizados con DLSS 5.0. Creo que esta es una reacción exagerada significativa. Hay muchos jugadores que odian la mayoría de las cosas mejoradas con IA, y la reacción a DLSS 5.0 puede ser la culminación de esa frustración. Habiendo visto las demostraciones en persona, puedo decir que casi todas las mejoras parecen ser positivas y realzan el realismo, y esto proviene de un fotógrafo serio que puede ser muy exigente con las herramientas de edición. Más allá de eso, DLSS 5.0 aún está lejos de enviarse, por lo que no está claro exactamente cómo se verá el producto final o qué GPU podrán ejecutarlo. La creación de instancias actual se ejecuta en dos tarjetas gráficas Nvidia RTX 5090, pero, según Nvidia, el software se optimizará para ejecutarse en una sola GPU en otoño.

El punto de inflexión de la inferencia y la proyección de mercado de 1 billón de dólares de Huang

En sus comentarios en GTC, Huang habló sobre la creciente oportunidad de ingresos de la IA para la industria y agregó que "la demanda de GPU de Nvidia está fuera de serie". Afirmó que el crecimiento de la inferencia está generando ingresos significativamente mayores desde la edición especial de GTC celebrada en Washington, D.C., a finales de 2025 (sobre la cual escribí aquí).

Aunque eso fue hace solo unos meses, la compañía ahora está mejorando su oportunidad de ingresos proyectada de 500 mil millones de dólares hasta 2026 a 1 billón de dólares hasta 2027. Esto significa que Nvidia no solo espera que este año termine fuerte sino que también espera que 2027 sea aún más fuerte:cientos de miles de millones de dólares más fuertes. Desde mi perspectiva como analista, tenía sentido pensar que la transición del entrenamiento en IA a la inferencia generalizada de IA y a la IA agente omnipresente sería un impulsor importante para la industria. Pero si Huang tiene razón, podría resultar un catalizador de crecimiento aún mayor (para Nvidia y sus socios) de lo que nadie hubiera imaginado no hace mucho.

Divulgación:Nvidia es cliente asesor de mi empresa, Moor Insights &Strategy.

Artículos Destacados

- Las 15 mejores ideas de negocios en línea para ganar dinero desde cualquier lugar

- ¿Qué es una empresa de adquisición de propósito especial (SPAC)?

- Inteligencia integradora para una cosmovisión empresarial basada en la confianza

- ¿Qué es Holacracy?

- Piense de nuevo:cómo los buenos líderes pueden evitar malas decisiones

- ¿Qué es Cross Holding?

- Cómo funcionan las ideas de negocios

- ¿Qué es la centralización?

- ¿Qué es la subcontratación de procesos de negocio (BPO)?

-

¿Cuáles son los registros de precios del petróleo crudo West Texas Intermediate?

¿Cuáles son los registros de precios del petróleo crudo West Texas Intermediate? El crudo West Texas Intermediate ha tocado máximos y mínimos históricos en los últimos 12 años. Una luz crudo dulce que se comercializa y entrega en Cushing, Oklahoma, un centro clave de EE. UU., se...

-

Cómo 4 mamás están ganando seguridad financiera a través de ajetreos secundarios

Cómo 4 mamás están ganando seguridad financiera a través de ajetreos secundarios Si bien el modelo de oficina tradicional de 9 a 5 tarda en adaptarse a las necesidades de los padres modernos, algunas mamás y papás están tomando el asunto en sus propias manos. Están buscando formas...